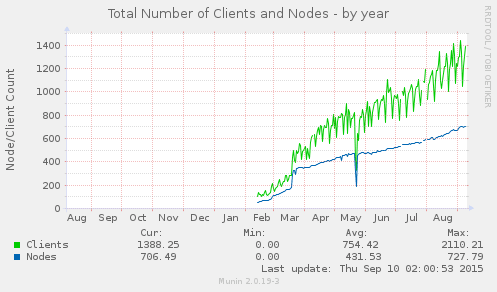

Im Regelbetrieb haben wir in der Regio Aachen vier Supernodes für unsere gut 500 Knoten, es werden jeweils zwei Tunnel aufgebaut.

Durch diese zwei Tunnel entsteht eine enorme Vielzahl an möglichen Wegen wie sich Knoten indirekt über die Supernodes zu erreichen können.

Konkret zu sehen mittels „batctl o“, teilweise sind einige hunderttausend Next Hops verfügbar.

Nachdem andere Domänen sehr gute Erfolge mit der Reduzierung der VPN Tunnel auf einen pro Knoten gemacht haben, aber ich versuchsweise zwie von unseren vier Supernodes abgeschaltet. Da wir bereits mein einem Feature aus Gluon 2015.1 erzwingen, dass zu den verbleibenden Supernodes insgesamt nur ein Tunnel aufgebaut wird habe ich damit effektiv die Zahl der Tunnel annähernd halbiert.

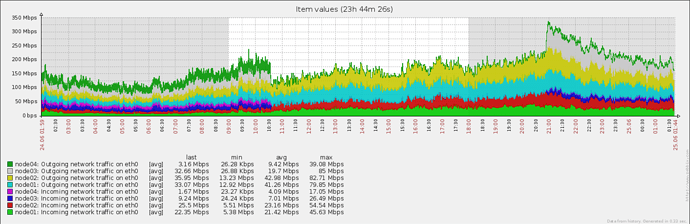

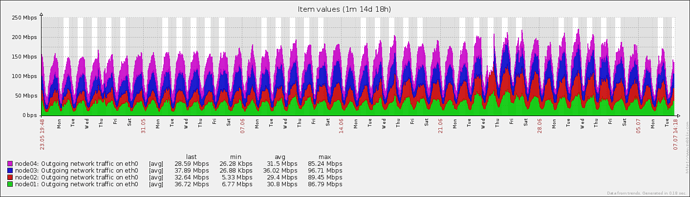

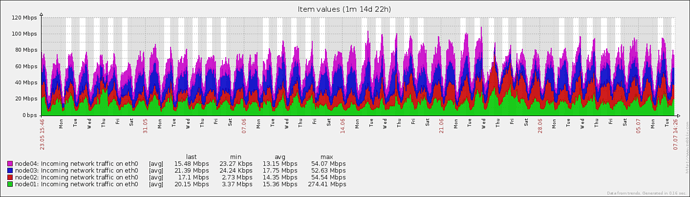

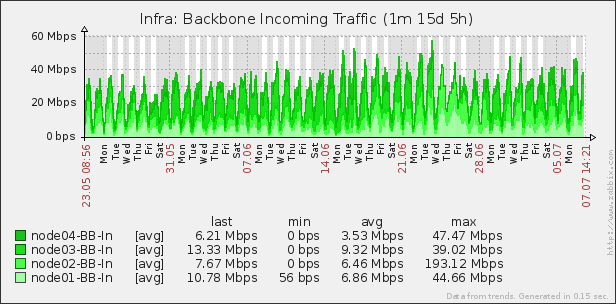

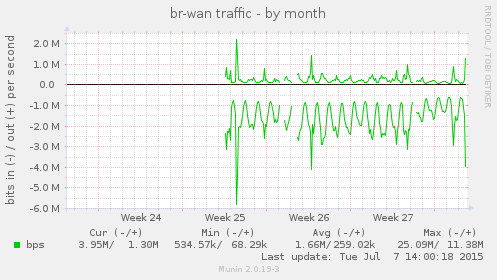

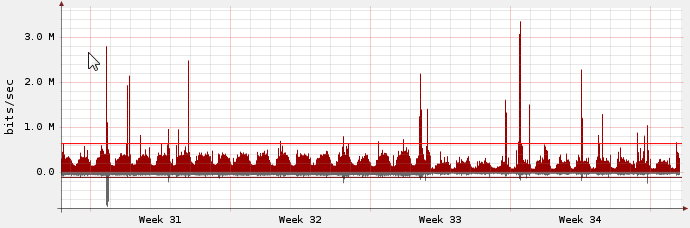

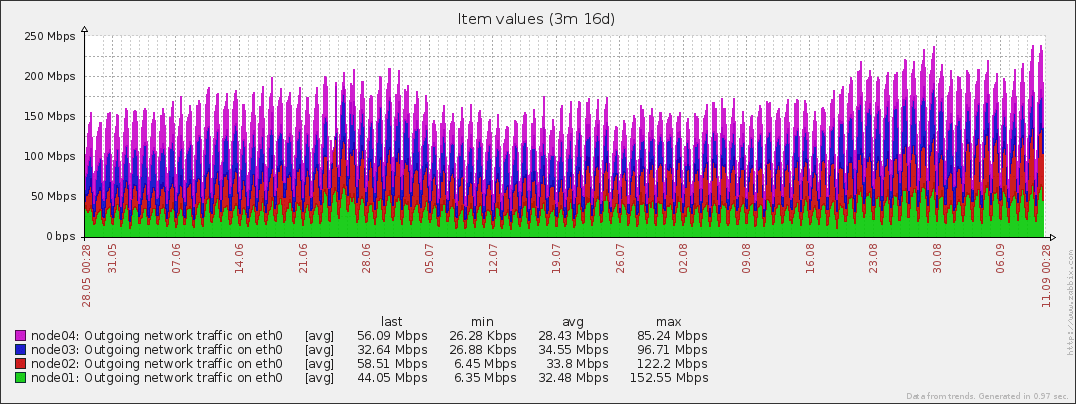

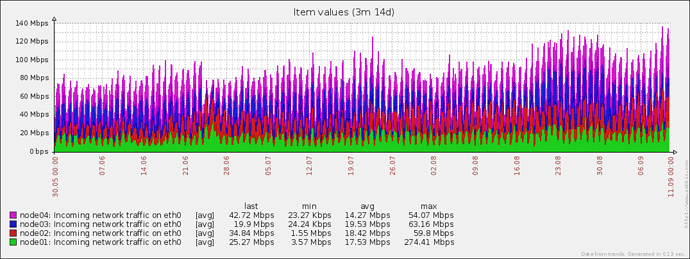

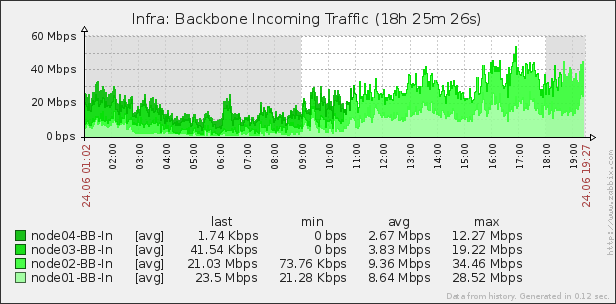

Mit dem Abschalten der Nodes 3&4 wurde der Traffic zum Rheinland Backbone wie erwartet von Node 1&2 übernommen:

Erstaunlich ist dabei, dass der Gesmatträffic auf Node 1&2 dabei nicht zugenommen hat:

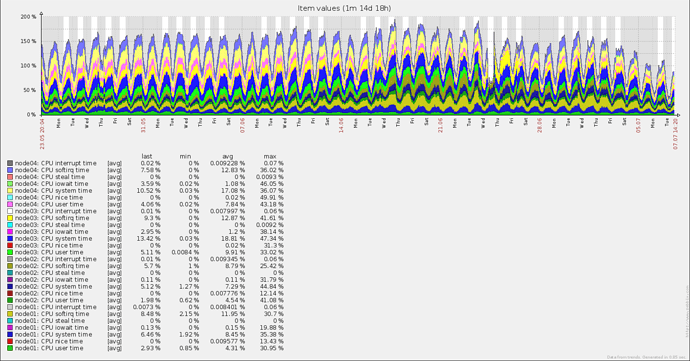

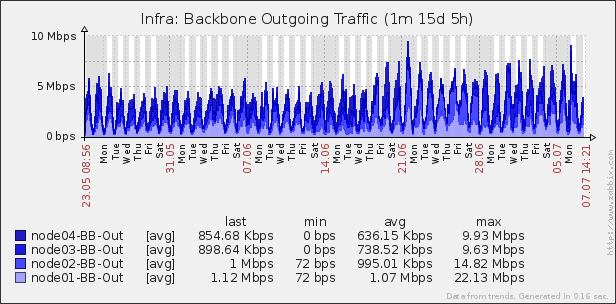

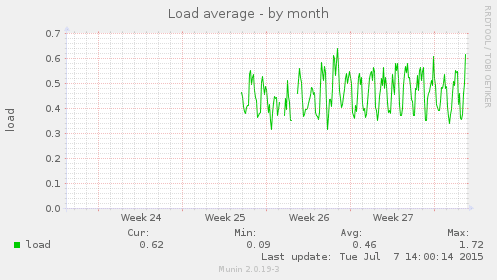

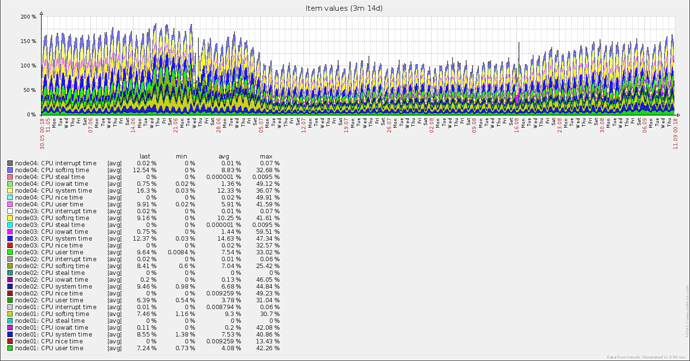

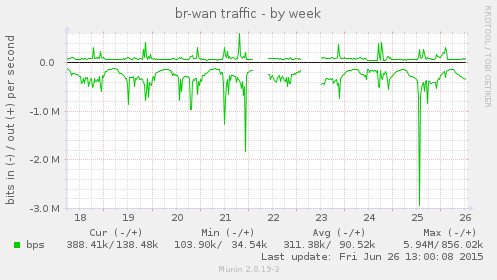

Der Overhead hat also massiv abgenommen, ohne dass es zu einer deutlichen Mehrbelastung gekommen ist:

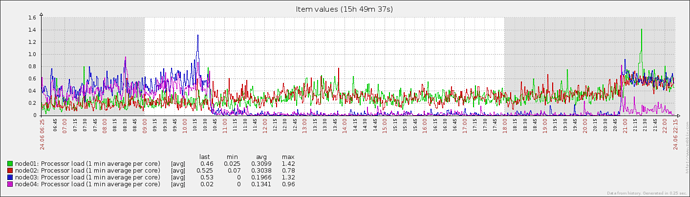

Effektiv ist die load auf den Supernodes 1&2 beim zuschalten von 3&4 sogar gestiegen.Effektiv ist die load auf den Supernodes 1&2 beim wieder zuschalten von 3&4 sogar gestiegen. Wobei das zuschalten notwendig war, da Video Streaming nicht mehr in HD möglich war.

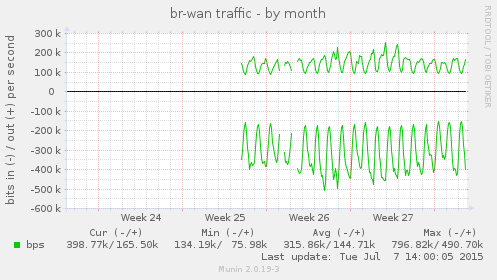

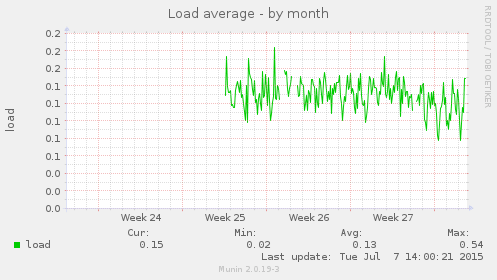

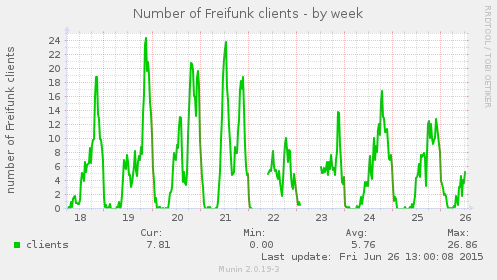

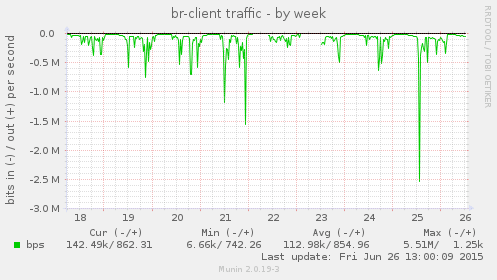

Auf Seite der nomalen Knoten fehlt mir leider ein Knoten mit dem ich deutlich zeigen kann ob der Hintergrund Traffic deutlich gefallen ist (Testzeitraum 24. Tagsüber), ich habe mal einen mit wenig User Traffic raus gesucht:

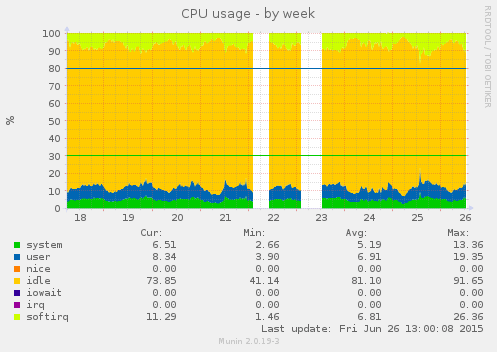

Immerhin, ein Rückgang der CPU Last ist zu erkennen:

Was lernen wir daraus:

- Wir könnten derzeit die Domäne Aachen auch mit zwei Supernodes betreiben, wenn man sich die Last genau anschaut, bei geringen Abstrichen in Sachen Perfomance vermutlich sogar mit einem.

- Weniger VPN Tunnel sorgen für eine deutlich geringere Belastung der Infrastruktur, insbesondere in Sachen Bandbreite.